动态监测系统在电力市场环境下的应用

1

2021

... 随着城市化和工业化的快速发展,电力设施的数量和分布呈现出日益复杂的趋势[1].目前,电力设施检测面临着一系列挑战,包括复杂的地形、变化多端的气象条件以及电力设施本身的多样性[2].在这一背景下,迫切需要更为智能、高效的检测方法来应对这些挑战[3-4]. ...

Application of dynamic monitoring system in electric power market

1

2021

... 随着城市化和工业化的快速发展,电力设施的数量和分布呈现出日益复杂的趋势[1].目前,电力设施检测面临着一系列挑战,包括复杂的地形、变化多端的气象条件以及电力设施本身的多样性[2].在这一背景下,迫切需要更为智能、高效的检测方法来应对这些挑战[3-4]. ...

冰灾天气下考虑输配协同的电-热联合系统韧性提升策略

1

2024

... 随着城市化和工业化的快速发展,电力设施的数量和分布呈现出日益复杂的趋势[1].目前,电力设施检测面临着一系列挑战,包括复杂的地形、变化多端的气象条件以及电力设施本身的多样性[2].在这一背景下,迫切需要更为智能、高效的检测方法来应对这些挑战[3-4]. ...

Enhancing resilience in electric-heat combined system:coordinated approach for transmission and distribution network during ice disasters

1

2024

... 随着城市化和工业化的快速发展,电力设施的数量和分布呈现出日益复杂的趋势[1].目前,电力设施检测面临着一系列挑战,包括复杂的地形、变化多端的气象条件以及电力设施本身的多样性[2].在这一背景下,迫切需要更为智能、高效的检测方法来应对这些挑战[3-4]. ...

基于改进PP-YOLOv2的红外图像电力设备检测

1

2023

... 随着城市化和工业化的快速发展,电力设施的数量和分布呈现出日益复杂的趋势[1].目前,电力设施检测面临着一系列挑战,包括复杂的地形、变化多端的气象条件以及电力设施本身的多样性[2].在这一背景下,迫切需要更为智能、高效的检测方法来应对这些挑战[3-4]. ...

Infrared image power equipment detection based on improved PP-YOLOv2

1

2019

... 随着城市化和工业化的快速发展,电力设施的数量和分布呈现出日益复杂的趋势[1].目前,电力设施检测面临着一系列挑战,包括复杂的地形、变化多端的气象条件以及电力设施本身的多样性[2].在这一背景下,迫切需要更为智能、高效的检测方法来应对这些挑战[3-4]. ...

基于改进YOLOv4的架空线路电力设备故障检测

1

2023

... 随着城市化和工业化的快速发展,电力设施的数量和分布呈现出日益复杂的趋势[1].目前,电力设施检测面临着一系列挑战,包括复杂的地形、变化多端的气象条件以及电力设施本身的多样性[2].在这一背景下,迫切需要更为智能、高效的检测方法来应对这些挑战[3-4]. ...

Fault detection for overhead line power equipment based on improved YOLOv4

1

2023

... 随着城市化和工业化的快速发展,电力设施的数量和分布呈现出日益复杂的趋势[1].目前,电力设施检测面临着一系列挑战,包括复杂的地形、变化多端的气象条件以及电力设施本身的多样性[2].在这一背景下,迫切需要更为智能、高效的检测方法来应对这些挑战[3-4]. ...

基于图像边缘检测和法向探测的导线覆冰监测方法

1

2023

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

A conductor icing monitoring method based on image edge detection and normal direction detection

1

2023

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

基于多策略分割融合与形态特征辨识的变电站保护压板状态识别

1

2022

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

Protection platen status recognition for a smart substation based on multi-strategy segmentation and fusion and morphological feature identification

1

2022

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

输电线路典型目标图像识别技术研

1

2012

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

Research on typical target image recognition technology of transmission lines

1

2012

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

面向高分辨率卫星遥感的电力杆塔自动检测

1

2021

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

Automatic power tower detection for high-resolution satellite Remote sensing

1

2021

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

基于样本扩充的Faster R-CNN电网异物监测技术

1

2020

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

Faster R-CNN foreign body monitoring technology based on sample expansion

1

2020

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

可变形网络与迁移学习相结合的电力塔遥感影像目标检测法

1

2020

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

Remote sensing image detection method of power tower based on deformable network and transfer learning

1

2020

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

基于深度神经网络的电力电缆故障检测方法研究

1

2020

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

Research on power cable fault detection method based on deep neural network

1

2020

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

Intelligent diagnosis of incipient fault in power distribution lines based on corona detection in UV-visible videos

1

2020

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

基于卷积神经网络的电力设备红外图像检测方法研究

1

2021

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

Research on infrared image detection method of power equipment based on convolutional neural network

1

2021

... 早期的电力设施检测研究主要基于传统的图像处理方法,如边缘检测[5]、阈值分割[6]和轮廓检测[7]等,但这些方法存在一些局限性,如对光照、视角变化敏感,依赖手工设计特征等.随着深度学习技术的发展,越来越多的研究者开始尝试将深度学习方法应用于电力设施检测中.文献[8]通过样本数据增广,结合最新的目标检测框架,利用高分辨率卫星图像实现了对电力杆塔的自动检测,并在实验中取得了良好的检测效果.文献[9]采用Faster R-CNN (region-based convolutional neural network)算法,并将隐患目标与背景图像融合,解决了样本不足的问题,为电网安全运行提供了有效监测手段.文献[10]结合可变形网络和迁移学习,对Faster R-CNN进行改进,该框架包括特征提取和目标检测2个部分,利用可变形网络模型改进卷积层提取电力塔几何形变特征,通过模型迁移实现精确检测.文献[11]提出了一种基于深度神经网络的电缆故障检测方法,通过无监督预训练和参数微调,利用仿真数据完成模型训练,并实现了实时故障检测.文献[12]提出了一种基于深度学习的紫外-可见视频处理方法,用于配电线路早期故障诊断.文献[13]利用神经网络的特征学习能力,能够自动提取红外图像中的关键特征并进行故障检测.以上基于深度学习的算法虽然取得了不错的效果,但仍存在以下问题:1)单一传感器在电力设施检测的应用中存在一定的局限性;2)深度学习中存在过多卷积,导致深层次特征图像信息丢失;3)难以识别尺寸较小和处于复杂背景的物体. ...

机器视觉技术在电力安全监控中的应用综述

1

2022

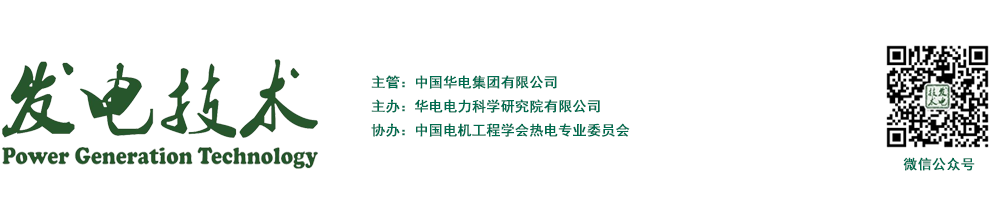

... 由于电力设施自身的特点,利用多源图像可以从多个角度反映出电力设备的故障特征,其中红外图像不受气候和光照等条件的限制,从而更加准确地捕捉设备的温度变化[14].此外,可见光图像采用与人类视觉系统兼容的方式提供高分辨率和高清晰度的纹理细节图像,可以清晰地呈现设备的外观细节.因此,基于红外和可见光图像融合的目标检测技术成为解决以上问题的一种新途径[15-18].该技术不仅能从源图像中提取关键信息,而且在不引入伪影的情况下整合到融合图像中,生成具有较高鲁棒性和较多信息量的图像,有助于后续的处理和决策[19-20]. ...

Areview of the application of machine vision in power safety monitoring

1

2022

... 由于电力设施自身的特点,利用多源图像可以从多个角度反映出电力设备的故障特征,其中红外图像不受气候和光照等条件的限制,从而更加准确地捕捉设备的温度变化[14].此外,可见光图像采用与人类视觉系统兼容的方式提供高分辨率和高清晰度的纹理细节图像,可以清晰地呈现设备的外观细节.因此,基于红外和可见光图像融合的目标检测技术成为解决以上问题的一种新途径[15-18].该技术不仅能从源图像中提取关键信息,而且在不引入伪影的情况下整合到融合图像中,生成具有较高鲁棒性和较多信息量的图像,有助于后续的处理和决策[19-20]. ...

基于深度学习的空预器转子红外补光图像积灰状态识别

1

2022

... 由于电力设施自身的特点,利用多源图像可以从多个角度反映出电力设备的故障特征,其中红外图像不受气候和光照等条件的限制,从而更加准确地捕捉设备的温度变化[14].此外,可见光图像采用与人类视觉系统兼容的方式提供高分辨率和高清晰度的纹理细节图像,可以清晰地呈现设备的外观细节.因此,基于红外和可见光图像融合的目标检测技术成为解决以上问题的一种新途径[15-18].该技术不仅能从源图像中提取关键信息,而且在不引入伪影的情况下整合到融合图像中,生成具有较高鲁棒性和较多信息量的图像,有助于后续的处理和决策[19-20]. ...

Ash accumulation state identification for infrared compensation images of air preheater rotor based on deep learning method

1

2022

... 由于电力设施自身的特点,利用多源图像可以从多个角度反映出电力设备的故障特征,其中红外图像不受气候和光照等条件的限制,从而更加准确地捕捉设备的温度变化[14].此外,可见光图像采用与人类视觉系统兼容的方式提供高分辨率和高清晰度的纹理细节图像,可以清晰地呈现设备的外观细节.因此,基于红外和可见光图像融合的目标检测技术成为解决以上问题的一种新途径[15-18].该技术不仅能从源图像中提取关键信息,而且在不引入伪影的情况下整合到融合图像中,生成具有较高鲁棒性和较多信息量的图像,有助于后续的处理和决策[19-20]. ...

面向电力设备故障检测的红外与可见光图像融合算法研究

0

2023

Research on infrared and visible light image fusion algorithm for power equipment fault detection

0

2023

红外与可见光图像融合方法及在电力设备监测的应用研究

0

2022

Research on infrared and visible image fusion method and its application in power equipment monitoring

0

2022

Infrared and visible image fusion methods and applications:a survey

1

2019

... 由于电力设施自身的特点,利用多源图像可以从多个角度反映出电力设备的故障特征,其中红外图像不受气候和光照等条件的限制,从而更加准确地捕捉设备的温度变化[14].此外,可见光图像采用与人类视觉系统兼容的方式提供高分辨率和高清晰度的纹理细节图像,可以清晰地呈现设备的外观细节.因此,基于红外和可见光图像融合的目标检测技术成为解决以上问题的一种新途径[15-18].该技术不仅能从源图像中提取关键信息,而且在不引入伪影的情况下整合到融合图像中,生成具有较高鲁棒性和较多信息量的图像,有助于后续的处理和决策[19-20]. ...

Fusion method for infrared and visible images by using non-negative sparse representation

1

2014

... 由于电力设施自身的特点,利用多源图像可以从多个角度反映出电力设备的故障特征,其中红外图像不受气候和光照等条件的限制,从而更加准确地捕捉设备的温度变化[14].此外,可见光图像采用与人类视觉系统兼容的方式提供高分辨率和高清晰度的纹理细节图像,可以清晰地呈现设备的外观细节.因此,基于红外和可见光图像融合的目标检测技术成为解决以上问题的一种新途径[15-18].该技术不仅能从源图像中提取关键信息,而且在不引入伪影的情况下整合到融合图像中,生成具有较高鲁棒性和较多信息量的图像,有助于后续的处理和决策[19-20]. ...

Integrated multilevel image fusion and match score fusion of visible and infrared face images for robust face recognition

1

2008

... 由于电力设施自身的特点,利用多源图像可以从多个角度反映出电力设备的故障特征,其中红外图像不受气候和光照等条件的限制,从而更加准确地捕捉设备的温度变化[14].此外,可见光图像采用与人类视觉系统兼容的方式提供高分辨率和高清晰度的纹理细节图像,可以清晰地呈现设备的外观细节.因此,基于红外和可见光图像融合的目标检测技术成为解决以上问题的一种新途径[15-18].该技术不仅能从源图像中提取关键信息,而且在不引入伪影的情况下整合到融合图像中,生成具有较高鲁棒性和较多信息量的图像,有助于后续的处理和决策[19-20]. ...

STDFusionNet:an infrared and visible image fusion network based on salient target detection

1

2021

... 损失函数的设置是为了表达源图像和融合图像之间的信息差异,并指导网络向期望的结果发展.本文结合显著目标掩模,对显著区域和背景区域分别构造像素损失和梯度损失[21],保持区域的完整性. ...

Infrared and visual image fusion through infrared feature extraction and visual information preservation

1

2017

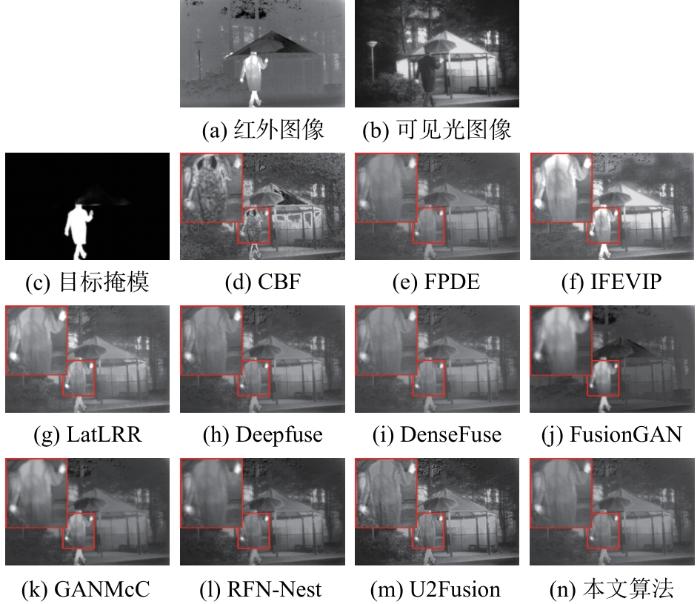

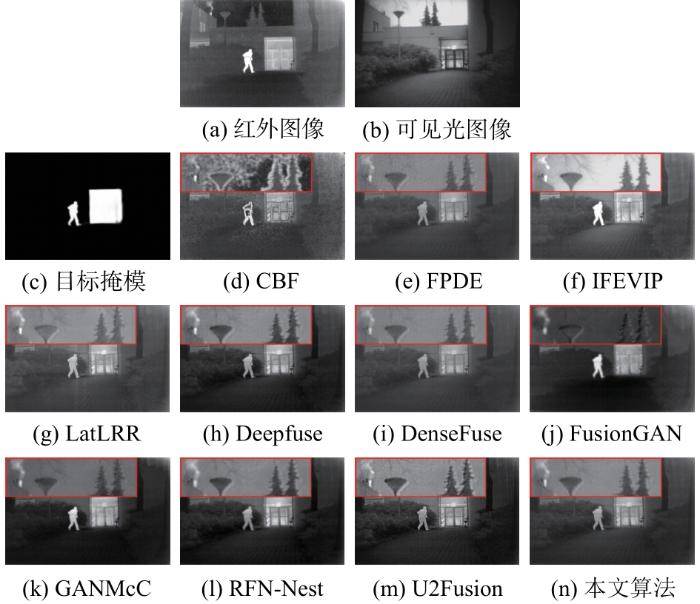

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

Image fusion based on pixel significance using cross bilateral filter

1

2015

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

Multi-sensor image fusion based on fourth order partial differential equations

1

2017

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

Infrared and visible image fusion using latent low-rank representation

1

2018

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

DenseFuse:a fusion approach to infrared and visible images

1

2018

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

Deepfuse:a deep unsupervised approach for exposure fusion with extreme exposure image pairs

1

2017

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

FusionGAN:a generative adversarial network for infrared and visible image fusion

1

2019

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

RFN-Nest:an end-to-end residual fusion network for infrared and visible images

1

2021

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

GANMcC:a generative adversarial network with multiclassification constraints for infrared and visible image fusion

1

2020

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

U2Fusion:a unified unsupervised image fusion network

1

2022

... 为了验证所提异构图像融合算法的有效性,将其与TNO数据集上先进的10种融合方法进行对比,即红外特征提取和视觉信息保存(infrared feature extraction and visual information preser-vation,IFEVIP)[22]、交叉双边滤波(cross bilateral filter,CBF)[23]、四阶偏微分方程(fourth-order partial differential equations,FPDE)[24]、潜在低秩表示(latent low-rank representation,LatLRR)[25]、DenseFuse[26]、Deepfuse[27]、融合生成对抗网络(fusion generative adversarial network,FusionGAN)[28]、基于Nest的残差融合网络 (residual fusion network-Nest,RFN-Nest)[29]、多分类约束生成对抗网络(generative adversarial network with multiclassification constraints,GANMcC)[30]和统一无监督图像融合网络(unified unsupervised image fusion network,U2Fusion)[31].由于这10种方法的实现都是公开的,因此本文采用原文中的参数设置. ...

Fast detection fusion network (FDFnet):an end to end object detection framework based on heterogeneous image fusion for power facility inspection

1

2022

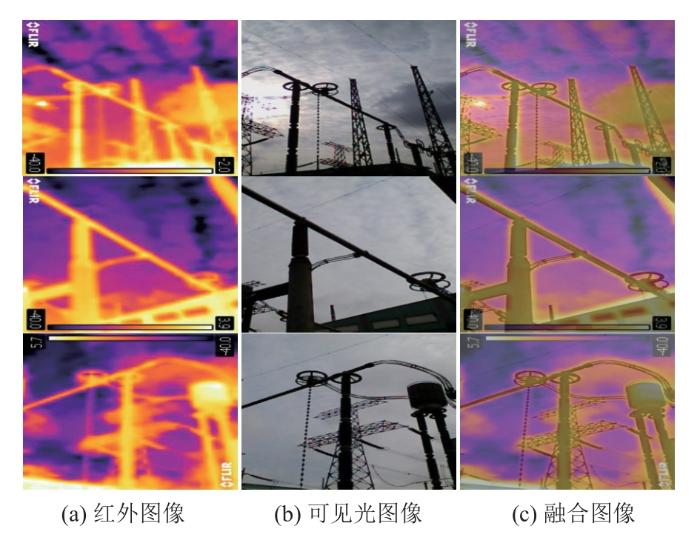

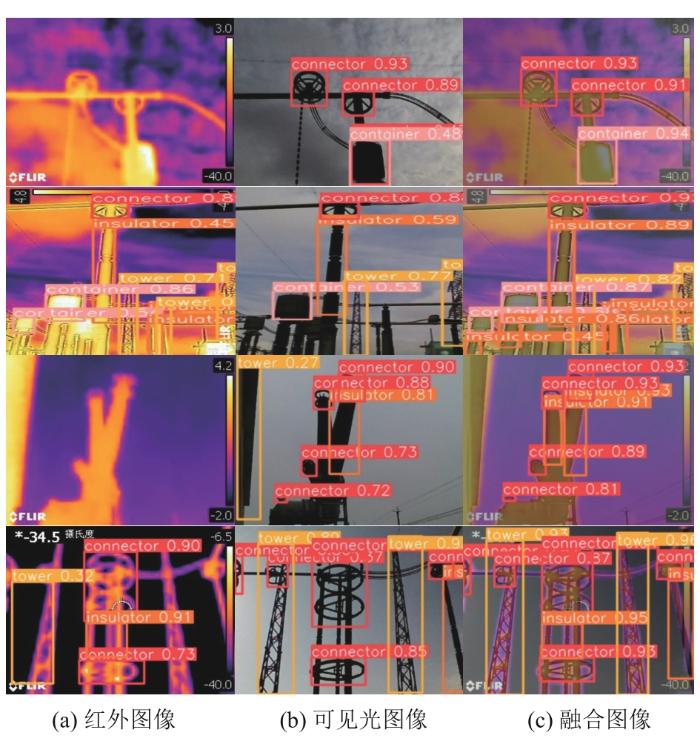

... 本文采用计算机视觉电力设施(computer vision power facility,CVPower)数据集[32],其由240组电力设施的红外和可见光图像组成.利用红外和可见光图像进行融合实验和目标检测实验,待检测的电力设施目标有连接器(connector)、容器(container)、绝缘子(insulator)和塔(tower) 4种.CVPower数据集具有纹理细节不明显、物体小而密、特征不明显、线性物体多的特点,能够测试模型的性能. ...

Insulator defect detection for power grid based on light correction enhancement and YOLOv5 model

1

2022

... 本文使用深度学习方法(YOLOv5[33])来识别电力设施,分别对红外图像、可见光图像和融合图像进行目标检测对比实验,结果如图7所示. ...